Les élections municipales de 2026 ont rappelé que les fragilités de l’espace informationnel en période électorale ne se manifestent pas de manière uniforme d’une plateforme à l’autre. En contexte électoral, la circulation de l’information ne relève plus seulement de la compétition politique ordinaire. Elle devient aussi un espace de confrontation entre récits, de façonnement des perceptions et d’exploitation possible des vulnérabilités du débat public. À ce titre, l’observation des contenus diffusés sur X et TikTok montre qu’un même événement politique ne produit pas les mêmes effets de circulation, de visibilité et d’amplification selon la plateforme concernée.

Sur TikTok, l’attention se concentre plus rapidement autour du scrutin lui-même. Sur X, les dynamiques discursives se prolongent davantage dans les jours qui suivent, au rythme des réactions, des commentaires et des polémiques. Cet écart ne tient pas seulement aux usages des internautes. Il renvoie aussi aux règles de visibilité propres à chaque plateforme, aux modes de diffusion qu’elles favorisent et aux leviers d’amplification qu’elles rendent possibles. Dans une perspective de lutte informationnelle, cette différence est centrale, car elle conditionne la manière dont certains récits s’imposent, dont des tensions peuvent être accentuées et dont des contenus à fort potentiel de polarisation trouvent un relais plus large.

L’exploitation de 985 publications collectées sur X et de 861 vidéos observées sur TikTok pendant les municipales françaises de mars 2026 met en évidence deux régimes distincts de circulation de l’information, qui font apparaître des fragilités différentes de l’espace informationnel selon la plateforme considérée. Si les pics d’activité se concentrent entre le 15 et le 17 mars, leur temporalité diffère nettement. TikTok atteint son intensité maximale dès le jour du scrutin, tandis que X prolonge le débat dans l’après-vote, au fil des réactions et des controverses. Un même événement électoral ne produit pas, selon la plateforme sur laquelle il est observé, le même espace d’expression, les mêmes conditions de visibilité ni le même potentiel d’exploitation des fragilités cognitives et informationnelles.

L’analyse du volume de publications met en évidence une hausse très nette de l’activité entre le 15 et le 17 mars 2026. Cette concentration confirme que le scrutin constitue le moment central de la séquence observée. Elle montre aussi que l’élection ne se résume pas au vote lui-même. Elle donne lieu à une succession de commentaires, de prises de position et de débats qui prolongent l’événement dans le temps.

Sur TikTok, le pic est atteint le 15 mars, soit le jour même du scrutin. Sur X, le maximum est observé le 17 mars. Ce décalage de quarante-huit heures traduit deux temporalités différentes. TikTok capte plus directement l’attention immédiate suscitée par l’événement. X accueille plus nettement un temps d’après-coup, où dominent les réactions, les interprétations et les controverses.

L’activité reste d’ailleurs soutenue dans les jours suivants. Elle ne retombe pas brutalement après le vote. Cela montre que la séquence électorale se prolonge dans une phase de commentaire et de qualification de l’événement. Les résultats ne sont pas seulement annoncés, ils sont discutés, contestés, mis en scène et réinterprétés. Cette concentration puis cette prolongation de l’activité créent une fenêtre favorable à l’exploitation d’émotions, à la réactivation de lignes de fracture et à l’installation de récits de contestation ou de délégitimation dans un moment où l’attention collective se focalise sur cette actualité.

La période précédant le 15 mars n’est pas non plus une phase neutre. L’observation des données montre une montée progressive de l’activité dans les jours qui précèdent le scrutin, marquée par l’émergence de prises de position partisanes et la structuration de lignes narratives distinctes selon les affinités politiques. Cette amorce pré-électorale constitue la première fenêtre d’exploitation informationnelle, celle où les récits sont introduits, testés et amplifiés avant même que les résultats ne soient connus. Elle précède et conditionne la réception que les publics feront des événements ultérieurs.

Le pic observé sur X au 17 mars présente une signification stratégique particulière dans une perspective de lutte informationnelle. Ce moment post-vote correspond à la phase de qualification des résultats, un temps où la légitimation ou la délégitimation du scrutin devient l’enjeu central du débat public. C’est précisément dans cet intervalle que les récits de contestation, d’irrégularité ou de dysfonctionnement institutionnel trouvent le terrain le plus favorable, car l’incertitude interprétative est à son maximum et l’attention collective reste mobilisée. Les modes opératoires informationnels documentés par VIGINUM dans des contextes comparables exploitent systématiquement cette fenêtre pour ancrer des perceptions de crise avant que les récits officiels ne s’imposent.

surtout utilisés par des acteurs institutionnels et médiatiques. Ils témoignent de stratégies de présence planifiée, destinées à maintenir une activité régulière.

X et TikTok n’organisent pas la circulation de l’information de la même façon. Sur X, la diffusion demeure en partie liée aux réseaux de relations entre comptes, à la reprise de publications, aux mentions et à la capacité de certains acteurs à occuper durablement l’espace de discussion. La visibilité dépend donc encore largement de la notoriété des comptes, de leur inscription dans des cercles déjà constitués et de leur capacité à maintenir une présence continue.

TikTok obéit à une autre logique. La visibilité d’un contenu dépend d’abord de sa capacité à capter l’attention et à susciter rapidement de l’interaction. Le poids du réseau propre à un compte y compte moins que sur X. Un contenu peut donc gagner en visibilité même lorsqu’il provient d’un compte qui ne dispose pas, au départ, d’une audience importante.

Cette différence est essentielle pour comprendre la circulation de l’information en période électorale. Sur X, les contenus circulent davantage dans des chaînes de reprise, de commentaire et de confrontation. Sur TikTok, ils dépendent plus directement de leur performance immédiate. Dans un cas, la circulation repose davantage sur la continuité, la répétition et l’inscription dans des réseaux visibles. Dans l’autre, elle dépend surtout de la capacité d’un contenu à être mis en avant rapidement par la plateforme.

Ces écarts sont déterminants, car ils n’offrent pas les mêmes prises aux acteurs de la menace informationnelle qui cherchent à peser sur les perceptions. X se prête davantage aux stratégies d’occupation, de répétition et de mise en controverse, tandis que TikTok offre des conditions plus favorables à une diffusion rapide par captation émotionnelle sur la base de contenus visuels.

Ces différences de logique ne sont pas seulement des propriétés abstraites des plateformes : elles se traduisent par des mécaniques algorithmiques concrètes qui structurent les possibilités d’amplification. Sur TikTok, les principaux signaux de classement taux de complétion de la vidéo, taux de partage externe, rapidité de l’engagement dans les premières minutes suivant la publication confèrent un avantage structurel aux contenus courts, émotionnellement chargés et visuellement saillants. Un acteur cherchant à maximiser la diffusion d’un message dispose ainsi d’une boussole claire : produire du contenu qui retient l’attention au-delà des trois premières secondes et suscite une réaction immédiate. Sur X, le phénomène dit d’“effet main character” où une publication devient le centre de débats contradictoires et accumule des réponses et des citations produit une visibilité qui bénéficie aussi bien à l’auteur original qu’aux voix qui s’y opposent. La controverse est en elle-même un moteur d’exposition, ce qui rend les contenus provocateurs ou clivants structurellement favorisés par la plateforme. Ces caractéristiques techniques ne sont pas neutres : elles définissent quels types de récits peuvent atteindre quelle échelle de circulation et dans quel délai.

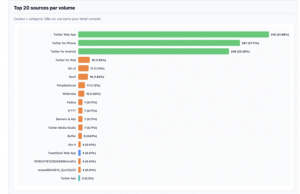

L’analyse des sources de publication fait apparaître des écarts nets entre X et TikTok. Sur X, 12,79 % des publications observées proviennent d’outils de programmation ou de services tiers. Cette part résulte de l’identification des applications et services utilisés pour publier les contenus, comme Nli v2, Nonli, PimpMySocial, Wildmoka, Buffer, IFTTT ou Fedica. Ces outils sont surtout utilisés par des acteurs institutionnels et médiatiques. Ils témoignent de stratégies de présence planifiée, destinées à maintenir une activité régulière.

Pour autant, les contenus publiés par ces moyens ne sont pas ceux qui suscitent le plus d’attention. Leur niveau d’engagement demeure inférieur à celui des publications organiques. Les contenus automatisés totalisent 31,4 K d’interactions, contre 470,4 K pour les contenus organiques. L’automatisation apparaît donc avant tout comme un moyen d’occuper l’espace de discussion de manière régulière, plus que comme un levier décisif d’attention.

Le pourcentage de 12,79 % doit cependant être lu avec précision. Les outils identifiés Buffer, IFTTT, Fedica, Wildmoka correspondent à ce qu’on peut désigner comme des pratiques de publication planifiée : elle servent à maintenir une présence régulière, à programmer des publications en dehors des heures de travail, et à diffuser des contenus éditoriaux sans intervention humaine constante. Ce type d’automatisation est essentiellement le fait d’acteurs institutionnels et médiatiques soucieux de ne pas disparaître de l’espace de discussion pendant les moments d’intensité. Elle se distingue analytiquement de l’automatisation offensive (comportements inauthentiques coordonnés), réseaux de comptes dormants réactivés, amplification artificielle de contenus ciblés qui produit des patterns de publication distincts : publications à horaires inhabituels, absence d’ancrage dans un réseau organique, engagement disproportionné par rapport à la taille de l’audience. Les données observées ne font pas apparaître de signal clair en faveur de cette seconde forme, mais la coexistence de contenus automatisés et de publications organiques à très fort engagement crée un environnement dans lequel la distinction reste difficile à opérer pour un utilisateur ordinaire.

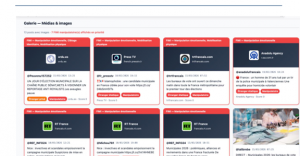

Sur TikTok, l’amplification suit une autre logique. L’examen des volumes de vues, des comptes émetteurs et des pics d’activité montre que plusieurs contenus très diffusés proviennent de comptes disposant au départ d’une audience limitée. La diffusion repose ici moins sur la position initiale du compte que sur la capacité du contenu à répondre aux critères de mise en avant de la plateforme. Cette caractéristique rend possible une montée rapide en visibilité de contenus portés par des acteurs disposant initialement d’une audience limitée.

Les métadonnées font aussi apparaître des contenus signalés comme partenariats rémunérés. Même s’ils restent minoritaires, ils montrent que les formes de diffusion non spontanée ne prennent pas la même apparence selon les plateformes. Sur X, elles relèvent plutôt d’une organisation éditoriale. Sur TikTok, elles passent davantage par l’intervention de figures déjà visibles et par l’intégration de contenus rémunérés dans les formats ordinaires de la plateforme.

Dans une logiques de guerre informationnelle, ces pratiques offrent des possibilités aux acteurs de la menace informationnelle, dès lors qu’elles permettent de donner à un récit une présence disproportionnée, de créer un effet de masse ou de banaliser un message par répétition. Même sans produire à elles seules l’adhésion, elles peuvent modifier l’environnement de réception et rendre certains contenus plus disponibles cognitivement.

L’analyse des mots employés dans les contenus publiés pendant la période électorale montre que les échanges s’organisent largement autour de registres émotionnels, polémiques et mobilisateurs. La concurrence pour la visibilité ne repose pas seulement sur le nombre de publications. Elle dépend aussi de la capacité à produire des contenus qui suscitent une réaction rapide.

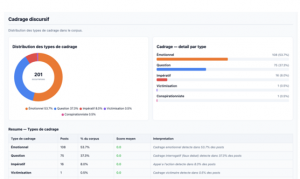

Sur TikTok, 53,7 % des occurrences identifiées relèvent d’un registre émotionnel, contre 37,3 % pour le cadrage interrogatif et 8 % pour les formulations injonctives d’appel à l’action. Cette répartition montre que la plateforme favorise surtout des contenus qui cherchent à toucher, à provoquer ou à mobiliser, plus qu’à informer de manière distanciée. Le vocabulaire observé reste relativement répétitif, avec un TTR de 0,33, et s’organise autour de termes génériques comme #france, #vote ou #election, associés à des marqueurs directement liés au scrutin, comme #municipales2026.

Sur X, certains termes à forte charge polémique, comme « scandale », jouent un rôle comparable. Ils condensent l’indignation et servent de points d’appui à des prises de parole venues d’horizons politiques différents. La présence à la fois de hashtags généralistes et de hashtags explicitement partisans, comme #lfi, #rn, #reconquête ou #macron, montre la coexistence de deux registres. Le premier relève d’une information large sur l’événement électoral. Le second s’inscrit dans une logique plus directement politique et partisane.

L’analyse des publications TikTok confirme cette importance de la mise en scène émotionnelle. Les emojis associés à l’appel à l’action représentent 36,3 % des occurrences relevées, contre 8,2 % pour les usages positifs et 2,8 % pour les usages liés à la peur ou à l’urgence. Le succès d’un contenu dépend donc aussi de sa capacité à susciter une réaction immédiate et à engager l’utilisateur.

Le TTR (Type-Token Ratio) de 0,33 observé sur TikTok mérite une attention particulière au-delà du simple constat de répétitivité lexicale. En termes cognitifs, l’exposition répétée aux mêmes marqueurs même sans attention délibérée produit ce que la littérature en psychologie cognitive désigne sous le nom d’effet de vérité illusoire : un énoncé ou un cadrage semble d’autant plus vrai qu’il a été rencontré fréquemment, indépendamment de sa véracité effective. Cette propriété est documentée dans le cadre DISARM sous la technique T0049 (saturation de l’espace informationnel) : l’accumulation de messages similaires rend un récit cognitivement disponible et facilite son acceptation. Sur X, les dynamiques de cluster partisan créées par les hashtags #lfi, #rn, #reconquête produisent un phénomène complémentaire : le biais de confirmation. Les utilisateurs inscrits dans ces réseaux sont exposés prioritairement à des contenus qui valident leurs croyances préexistantes, ce qui réduit leur capacité critique à l’égard des récits qui y circulent. Ces deux mécanismes effet de vérité illusoire et biais de confirmation se renforcent mutuellement en période électorale, car la saillance des enjeux politiques amplifie la réceptivité affective aux contenus qui s’inscrivent dans une vision du monde déjà constituée.

De la sorte, la manipulation cognitive trouve l’un de ses terrains les plus favorables. Des contenus émotionnels, répétitifs et polarisants abaissent le coût d’attention, encouragent les réactions immédiates et facilitent l’activation de biais de perception. Dans ce contexte électoral, ils peuvent ainsi accroître la réceptivité à des récits simplificateurs, conflictuels ou déstabilisateurs.

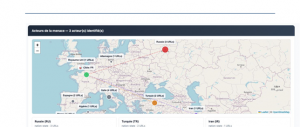

L’examen des URLs partagées dans les deux corpus montre que les flux observés restent très majoritairement liés à des sources nationales. Sur les 234 URLs analysées, 78,6 % renvoient vers des médias locaux. Une part plus réduite provient de médias étrangers privés, à hauteur de 15,8 %, tandis que 2,6 % renvoient à des médias étrangers financés par un État. L’espace observé n’apparaît donc pas comme massivement dominé par des acteurs extérieurs.

Ce constat ne doit cependant pas conduire à sous-estimer les vulnérabilités présentes. L’analyse fait apparaître des contenus issus de médias étrangers dont une partie présente des caractéristiques compatibles avec des logiques de manipulation de l’information. Les contenus identifiés comme manipulatoires proviennent en majorité de médias associés à trois États : la Russie, la Turquie et l’Iran. Leur volume reste limité, mais leur présence se concentre dans une période de forte intensité, ce qui peut accroître leur effet dans un moment déjà chargé en tensions et en commentaires.

Les messages associés à ces sources font apparaître trois axes récurrents. Le premier met en avant une image d’instabilité politique et institutionnelle. Le deuxième exploite des épisodes de violence ou de confrontation. Le troisième investit des thèmes identitaires ou religieux sensibles. Dans ces cas, l’enjeu n’est pas toujours de fabriquer une information entièrement fausse. Il peut aussi consister à sélectionner certains faits, à les mettre en avant et à leur donner un sens particulier afin de renforcer une perception de crise ou de désordre.

Le premier axe celui de l’instabilité institutionnelle s’appuie sur des faits réels : un taux d’abstention élevé, des controverses de gouvernance municipale, une polarisation politique visible. Ce qui le distingue d’un traitement journalistique ordinaire, c’est la systématicité du cadrage : ces éléments sont systématiquement agrégés et présentés non comme des aléas politiques ordinaires mais comme les symptômes d’une crise démocratique profonde et irréversible. L’objectif n’est pas d’informer sur un dysfonctionnement ponctuel, mais d’installer la perception que les institutions françaises sont structurellement fragiles et incapables de garantir la légitimité du processus électoral.

Les deuxième et troisième axes exploitation de la violence et investissement des thèmes identitaires tendent à opérer en combinaison. Des incidents impliquant des forces de l’ordre, des communautés minoritaires ou des symboles religieux sont amplifiés sélectivement, dépouillés de leur contexte et réorientés pour suggérer un état de fragmentation sociale que l’État ne serait ni capable ni désireux de résoudre. Cette logique est cohérente avec les modes opératoires informationnels documentés par VIGINUM dans ses analyses de Storm 1516 : ciblage systématique des lignes de fracture identitaires, amplification croisée entre plusieurs relais pour donner une impression de consensus narratif, et recyclage de contenus sur différentes plateformes pour maximiser leur exposition. Dans le contexte des municipales de 2026, ces contenus trouvent une résonance particulière dans les circonscriptions marquées par des tensions communautaires ou une compétition électorale serrée.

Ce point est important. L’influence en ligne ne repose pas nécessairement sur le mensonge pur. Elle peut s’appuyer sur des événements réels, sur des tensions déjà présentes dans le débat public ou sur des sujets sensibles, puis en orienter la lecture par répétition, sélection ou amplification. Les périodes électorales offrent pour cela un terrain favorable, car elles concentrent l’attention et rendent les publics plus réceptifs à des contenus simples, conflictuels ou émotionnels.

L’application des cadres FIMI et DISARM permet ici de préciser plusieurs procédés récurrents, parmi lesquels la saturation de l’espace de discussion, l’exploitation de récits déjà présents et la recherche d’une exposition maximale par répétition. Même lorsque ces procédés ne dominent pas les flux, ils peuvent suffire à brouiller la lecture d’un événement, à renforcer certains biais de perception et à nourrir la confusion entre information, mobilisation et instrumentalisation.

Ces observations appellent une réponse stratégique adaptée à la nature des ingérences observées. Face à des opérations qui n’opèrent pas par la fabrication de fausses informations mais par la sélection, l’amplification et la réorientation sémantique de contenus réels, la riposte ne peut se limiter au fact-checking ou aux démentis institutionnels. Ces instruments restent nécessaires, mais insuffisants face à des procédés dont la force tient précisément à leur ancrage dans des faits existants et dans des tensions sociales réelles. La réponse requiert une capacité de détection précoce des patterns d’amplification anormale, une lecture croisée et coordonnée des deux plateformes, et une cartographie régulièrement mise à jour des acteurs émetteurs et des relais d’amplification.

La plateforme STELAIR et les cadres FIMI/DISARM constituent à cet égard des instruments structurants pour l’organisation de la veille informationnelle en période électorale. Leur valeur ne tient pas seulement à la capacité technique de collecte et d’analyse : elle réside aussi dans la grille conceptuelle commune qu’ils fournissent pour qualifier les phénomènes observés, distinguer l’activité organique de l’amplification coordonnée, et identifier les procédés récurrents à travers des contextes différents. Cette standardisation analytique est une condition de la coopération entre acteurs autorités compétentes, plateformes, médias, société civile dont dépend in fine la capacité collective à préserver l’intégrité de l’espace informationnel lors des scrutins à venir.

Papa Djibril NGOM, Analyste au sein de la Commission Influence et Lutte Informationnelle (CILI) de l’INAS

L’INAS a pour mission de contribuer au débat public sur les questions stratégiques. Ses publications reflètent uniquement les opinions de leurs auteurs et ne constituent en aucune manière une position officielle de l’organisme.

Pour aller plus loin :